大厂内部几百万打磨出来的ab方法论和系统建设陪跑,你愿意付费多少?

- 快手 19-21 三年ab的迭代,基础的重叠框架、置信分析、累积效果分析、DID分析、流量检验体系

- Shopee 22-24三年ab的迭代,覆盖内容、电商的搜广推业务

- 游戏公司 25 半年快速从ab1.0升级到3.0,实现并行实验十百千的快速演进

半年的咨询服务周期,至多20次的现场沟通和交付,你愿意付费多少?

Plus:内容、电商、游戏行业数据应用的交流和分享。

大厂内部几百万打磨出来的ab方法论和系统建设陪跑,你愿意付费多少?

半年的咨询服务周期,至多20次的现场沟通和交付,你愿意付费多少?

Plus:内容、电商、游戏行业数据应用的交流和分享。

今年上半年参与了出海休闲游戏公司实验平台的迭代,基本实现了百-千量级的实验体量,并朝着万级稳步推进。

极致AB需要哪些天时地利人和的条件呢? 有兴趣的可以对号入座下。

数据意识以及管理层的推动在小公司做事是必须的。公司CEO在游戏行业摸爬滚打十几年,非常推崇数据驱动,也是得以入场做咨询的一个前置条件。

另外就是公司非常的扁平,CEO意志在公司可以无折扣的推进。

业务场景的收敛,出海休闲游戏业务场景非常聚焦,按照特性-tag-方案进行创意的管理,并对用户进行方案的干预。

场景的收敛可以让AB在流量控制、实验干预简化、自动化。

业务团队、研发团队、实验的数据团队(包括产品、研发、数据科学家)协同的非常顺畅,相互成就。

经历了4个版本的迭代,从创意到研发、实验、分析整个流程最大程度的实现了自动化

v1. 接入火山引擎进行分流和干预参数的分发,实验意识的启蒙和尝试。

v2.本地化的参数分发,跟贴近公司业务

v3.引入了互斥桶,流量的利用效率提升,可以支持10量级的实验

v4.引入正交流量框架、并打通版本发布、实验参数控制,支持100、1000量级的实验,后续计划引入AI创意、自动化测试以及更多参数化的特性,实现实验量级的再次×10。

有实验平台需求的欢迎沟通!

一位行业前辈对游戏机制的总结非常到位:通过核心玩法交付核心体验。

这里的玩法可以不同维度进行拆解

核心体验的交付包括玩法设计和迭代两个阶段

数据在核心玩法设计和迭代中可以发挥的作用

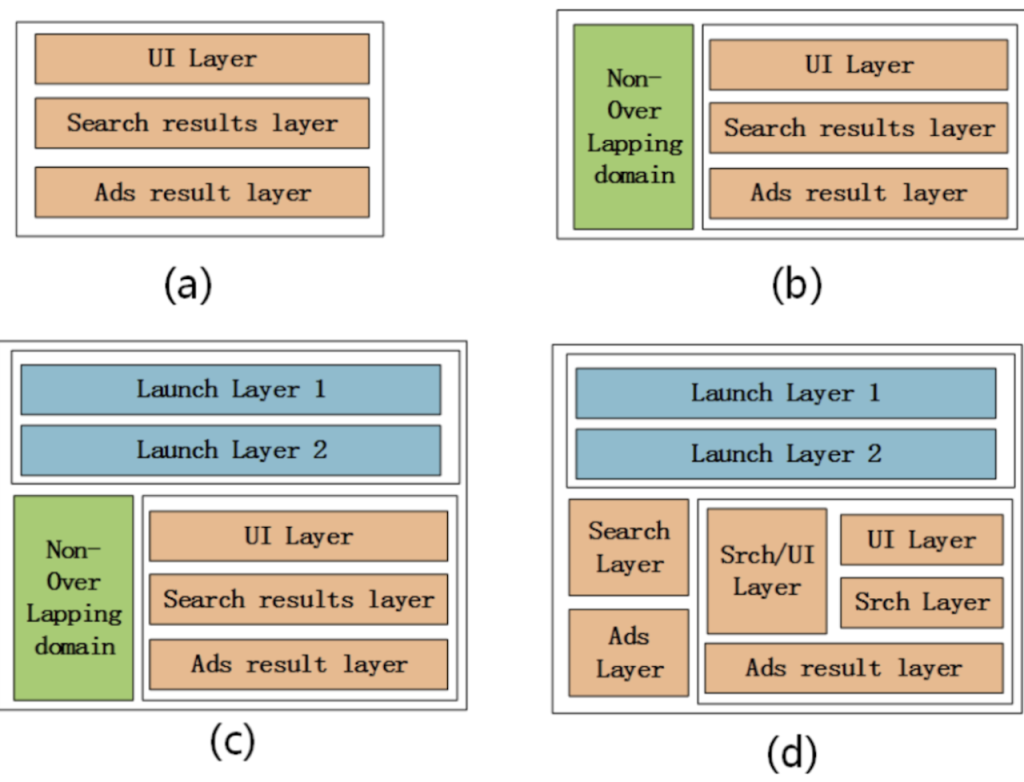

经手的实验平台多了以后从不同公司流量框架的设计和应用中吸取一些经验,下面展开说下我的理解

AB实验需要通过对随机、同质、独立的流量施加不同的方案,通过实验观测看不同方案的优劣。所以第一步是对自己流量的理解

AB实验方法由Google引入互联网后,实验方法成为各大公司标配。实验的本质对随机打散的同质、独立流量施加控制。按照流量生态的差异大概沉淀出以下的流量框架

市场上实验平台的设计都要在充分理解业务流量的基础上,解决流量分配随机、同质、独立要求,具体的实现路径就是重叠流量框架(在实验的时候再进行参数冲突控制)、基于约束的流量框架(本质是一种提前进行实验参数冲突控制的策略)

不同公司按照业务的复杂度,可以选择figure a-d四种不同复杂度的流量框架实现。

白皮书 中介绍了美团流量的特点、流量框架的设计,以及提供的一系列实验分析工具,整体上确保实验平台的科学可信。

参考:https://blog.51cto.com/u_15060460/2673616

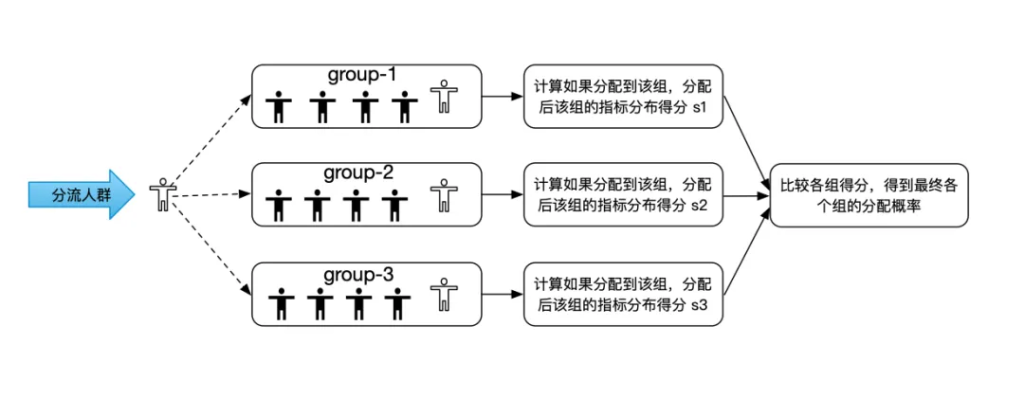

随机分流的过程中进行用户指标的平衡,增强流量的同质性

流量生态和流量框架的结合包括分流单元的定义和分流方法的选择。

通常的分流单元可以包括以下:

以上总结了实践中对流量生态理解、流量框架选择、以及具体流量框架实现中的一些考量。 关键要解决

从而确保流量框架的可信性、实验结果的科学置信。

典型的AB实验平台建设功能列表,可以参考:

| 需求大类 | 具体需求 | 需求分类 | 交付物 | 优先级 | 相关人 | 备注 |

| 业务理解 | 流量控制 | 文档 | 调研报告 | P0 | 业务团队AB产品&后端业务服务端 | 流量控制&实验方法:正交,互斥,缓存(加锁),继承,条件筛选 |

| 实验配置 | 文档 | 接口规范(AB后端) | P0 | AB产品&后端业务服务端 | 配置文件格式和schema | |

| 实验配置 | 配置管理 | 功能 | 配置后端(AB后端) | P0 | AB产品&后端配置管理员 | 按照配置协议进行配置管理 |

| 配置分发 | 功能 | TRD+分流服务 | P0 | AB产品&后端业务服务端 | AB后端提供分流接口、分流算法、缓存加锁(按需)业务服务端接入、返回客户端 | |

| 概念抽象 | 文档 | PRD+系统功能 | P1 | AB产品 | 项目,层,实验,分组,参数,条件等 | |

| 实验管理 | 实验列表 | 功能 | PRD+系统功能 | P2 | AB产研 | 实验列表以及实验管理功能(启停、扩缩、分组管理、参数管理、版本管理、审批、通知等) |

| 创建实验 | 功能 | PRD+系统功能 | P2 | AB产研 | 实验设计模板 ,包括 设计 目标 条件 埋点 指标 白名单 冲突检测等 | |

| 权限管理 | 功能 | PRD+系统功能 | P2 | AB产研 | 鉴权和数据隔离 | |

| 参数管理 | 功能 | PRD+系统功能 | P3 | AB产研业务产研 | 实验参数体系,提高实验效率,构建实验知识库 | |

| 最小样本量 | 功能 | PRD+系统功能 | P3 | AB产研分析师/DS | 依赖指标体系和实验分析方法支持 | |

| 流量检验 | 功能 | PRD+系统功能 | P3 | AB产研分析师/DS | 依赖指标体系和实验分析方法支持 | |

| 流量监控 | 功能 | PRD+系统功能 | P2 | AB产研数仓 | 进量监控、进量控制等 | |

| 数据链路 | 埋点 | 文档 | 埋点规范 | P0 | 客户端分析师数仓 | 埋点确认以支持实验分析 |

| 数据同步 | 数据 | 同步任务 | P1 | 数仓分析师 | 确保埋点事实数据落库、实验跟踪数据落库,支持实验分析 | |

| 数据建模 | 数据 | 数据资产 | P0 | 数仓分析师 | 分层的数据资产ods dwd dws ads dim | |

| 指标计算 | 指标计算 | 数据 | 计算任务 | P1 | AB产研数仓 | 预计算vs实时计算 |

| 指标定义 | 功能 | PRD+系统功能 | P3 | AB产研数仓分析师 | 分析师对口径负责 | |

| 实验分析 | 实验看板 | 功能 | PRD+系统功能 | P0 | AB产研分析师数仓 | 基础看板支持实验分析 |

| 多维分析 | 功能 | PRD+系统功能 | P3 | AB产研分析师数仓 | 支持多维分析(指标和数据体系的迭代增强) | |

| 置信分析 | 功能 | PRD+系统功能 | P3 | AB产研分析师/DS数仓 | 置信区间、P-value或者胜出概率 | |

| 置信计算 | 数据 | 计算任务 | P3 | AB产研分析师/DS数仓 | 数据资产确保支持统计量的计算 |

本文来源2022-09在Datafun上做的关于AB实验平台建设的分享。

A/B 实验应用作为论证的黄金方法,目前已经成为很多企业必然的选择,但是实际上如何在企业内部去建设实验平台,还充满了很多选择路径。目前的实验平台,包括在线实验的数量,已经成为衡量互联网公司体量、业务量以及用户量的一个隐藏指标。一些大厂的实验平台,同时在线实验数量超过 10000,可能每个月新建的实验数量都会大于 1000。

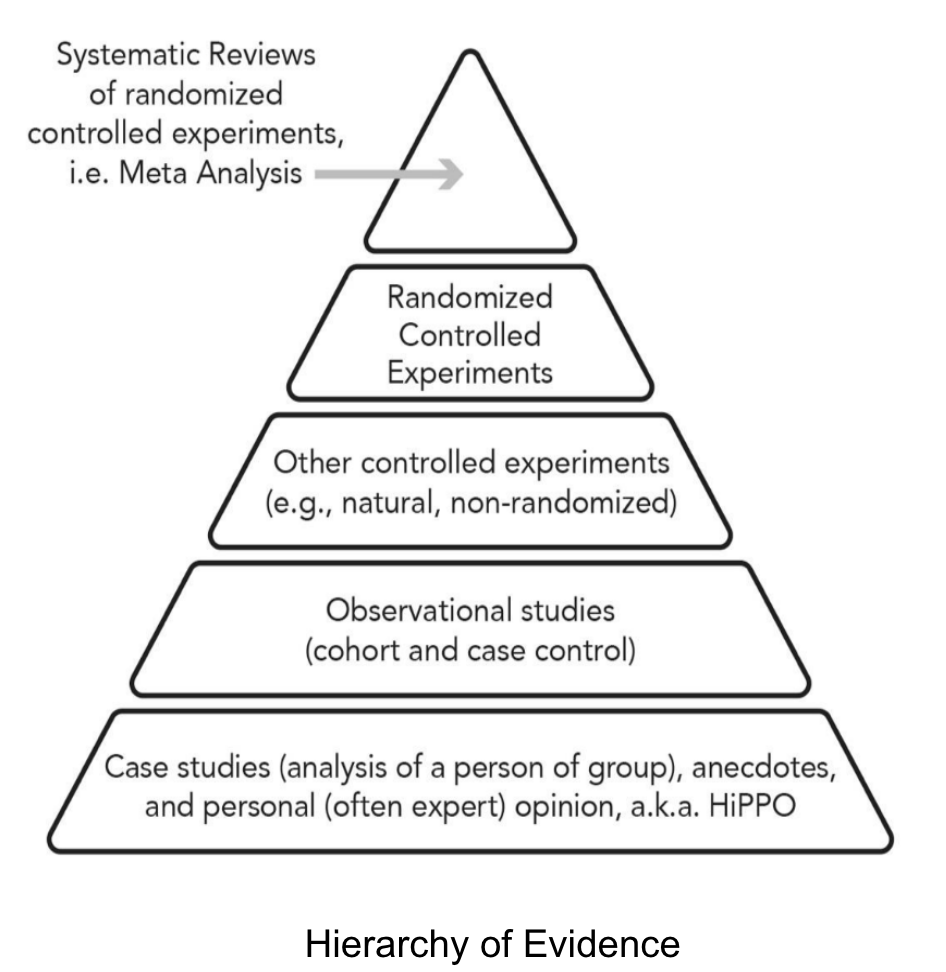

上图列出了一些数据分析方法,比如案例研究、观察研究、类实验、随机控制实验,以及统合分析,即结合随机实验和观察研究去做一些综合分析。

这几层分析方法中存在一些通用的因素,首先,样本是定向的样本还是随机的。第二个是有没有控制,比如最下面的案例研究是没有控制的,它可能针对一个群体做分析,而 AB 实验天然会分成对照组和实验组,是有控制的。最后一个就是实验结论是否可以复现,是否科学。这三个因素的不同导致了整个分析方法可信度的差异。从下往上,可信度逐步提升。AB 实验是分析成本最低的一个方法,可以通过工程化的方法来提效,通过 AB 产品化的方式来降低使用门槛。

AB 实验有三个主要的特点:

当然AB实验也不是万能的,一些适用和不适用场景:

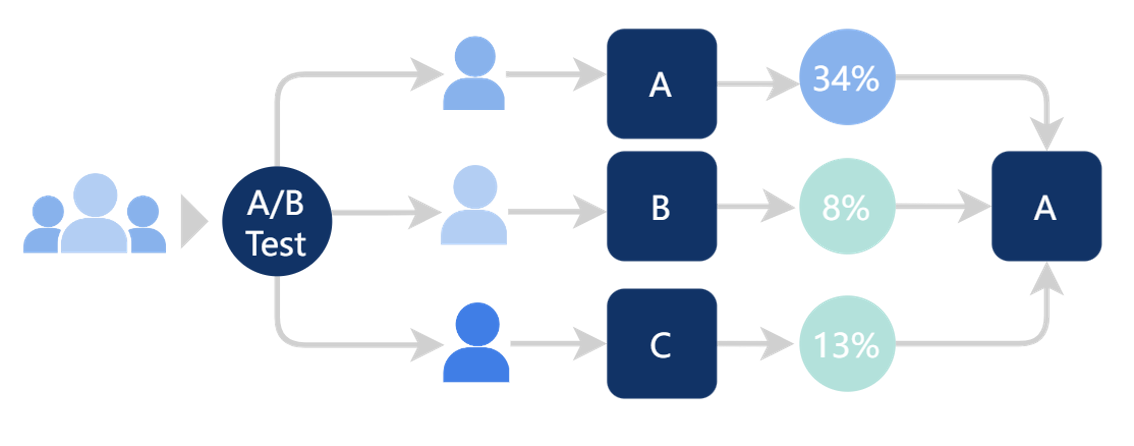

AB 实验源于假设检验。我们在线上流量中取出一小部分(较低风险),完全随机地分给原策略A和新策略B(排除干扰),再结合一定的统计方法,得到对于两种策略相对效果的准确估计(量化结果)。

这一套基于小样本的实验方法同时满足了低风险,抗干扰和量化结果的要求,因此不论在互联网产品研发还是科学研究中,都被广泛使用。

真实的业务场景,例如客户端交互实验、搜广推策略实验等场景承载大量的DAU,每天大量新的功能、算法及其他等待上线,一方面业务人员无法承担其中任何一个错误特性直接影响用户体验、商业收入的严重后果,另一方面业务人员又希望能够分离并量化每个特性的影响。

因此,我们需要设计并坚持使用一套数据驱动的方法,使得业务人员可以以较小的风险对新feature进行评估,积极试错积累经验;并且我们设计的该方法有能力排除其他因素(比如同时开发的其他feature以及时间因素等)的干扰;最后,除了‘好’或者‘不好’,我们希望这个方法最好也能够给出 定量的结果。

为了解决上述问题,普遍使用的方法论是小流量随机实验,也就是我们常说的AB实验。

AB实验包括三个核心要素:流量、干预、效果,其中流量满足:

同时实验设计三原则(由统计学家费希尔提出):区组,重复,随机。

整个 A/B 平台的建设,主要有两个思路,第一个就是直接采购第三方平台;另外一个就是自建平台。

国内目前比较好的第三方产品,比如火山引擎,无论是产品 feature 还是整个应用情况都比较好,因为它是基于自己内部的最佳实践。另外腾讯也开放了第三方平台。热云、神策数据也提供了 SaaS 的实验平台。国外的厂商也比较多,像 VWO 实验测试平台、谷歌的 Optimize、源自Meta的Statsig以及 Optimizely 等等,都是一些比较有竞争力的产品。

第三方平台通常适用于用户体量比较小,数据跟分析的基建还相对比较薄弱的公司。通过第三方平台的使用,提升公司内部数据以及分析的认知。

用户行为分析和 A/B 实验是紧密联系的,因为它们都是基于用户的行为,让用户来告诉我们答案,包括底层的一些分析引擎、存储引擎的等基建也都是可以复用的,这也是火山引擎的 A/B 测试和分析能力,和用户行为分析能力都是紧密耦合在一起的原因。

对于公司自建平台,国内主流的一些互联网厂商也都有很好的实验平台,比如滴滴、美团、阿里、网易、新浪微博等,甚至有一些公司内部有多个实验平台。国外的微软、谷歌也都有非常有特色的实验平台。这些公司也都是用户体量比较大,实验场景多,数据分析基础比较强的公司。在自建实验平台的时候,如果公司业务体量大的话,不同的业务可能结合自身的需求都建过一些实验平台了,这时候还要推动平台从 N 到 1 的建设。在新建平台时,就要考虑业界的最佳实践,同时还要考虑业务方的独特诉求。这样在公司内部推行实验平台的时候才能顺畅,并且最终可能变成全公司通用的实验平台。

业界一些实验平台建设案例和应用效果:

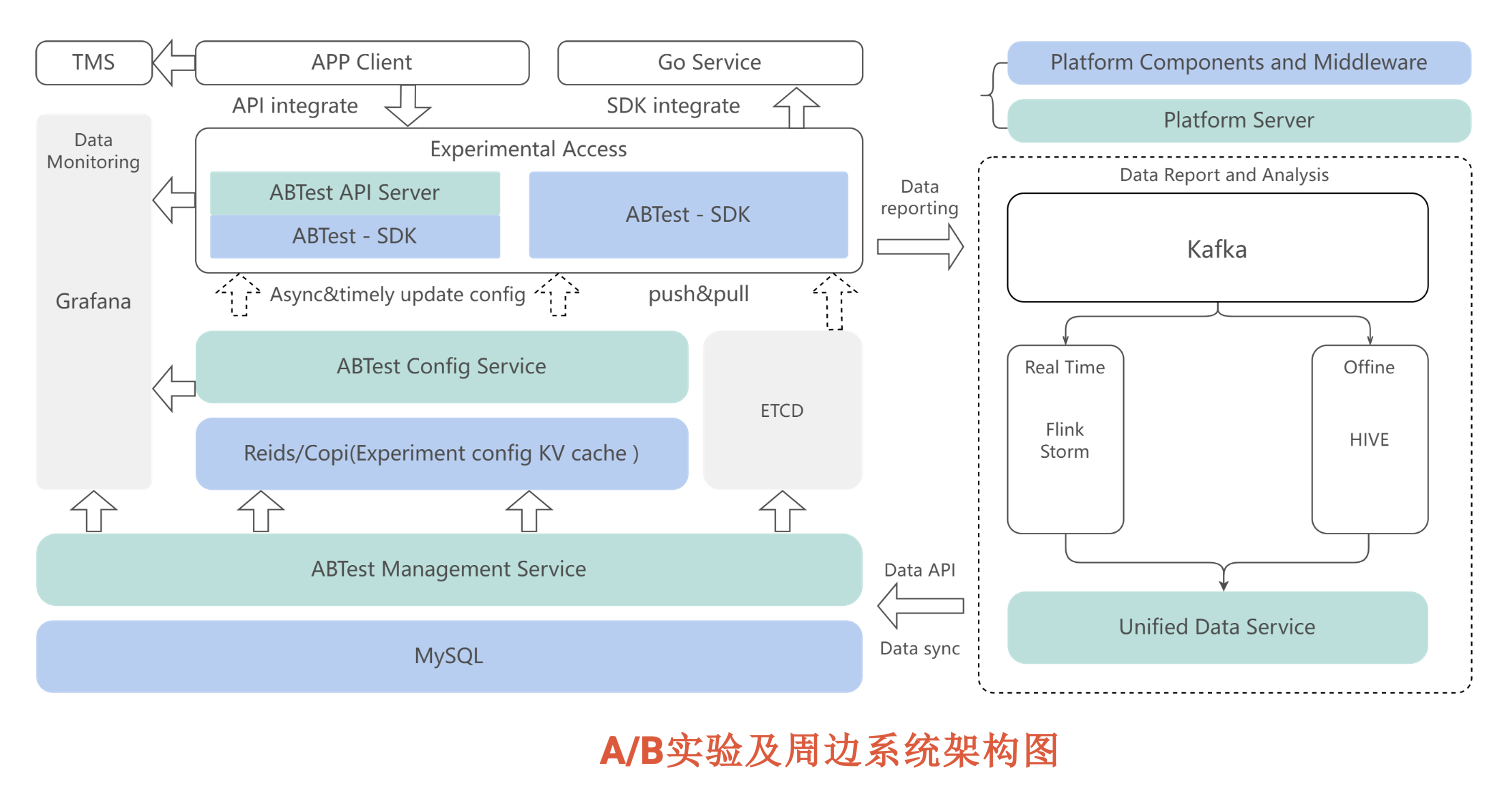

实验平台包括流量框架、实验管理以及实验分析等模块,同时需要相应的埋点TMS、数据工程的支撑。

Google、Microsoft、Facebook等互联网公司将AB实验的方法从医学领域引入并获得了巨大的业务收益。AB实验逐渐成为互联网公司最佳实践。

本人经历多个公司AB实验平台的迭代,包括内容行业快手、电商行业虾皮。关于平台搭建、运营以及实验设计、实验分析积累了一些经验。在业界交流中发现大量中小公司也有AB实验平台建设和应用的诉求,结合近期的咨询案例,如果咱们有下面的需求欢迎沟通。